Dyrektor generalnyNvidii, Jensen Huang, wygłosił inspirujące przemówienie na Siggraph, podkreślając udany zakład firmy na sztuczną inteligencję w 2018 roku. Gra się opłaciła, wprowadzając szereg nowych produktów i partnerstw. Wśród nich na szczególną uwagę zasługuje superukład "Grace Hopper" (GH), okrzyknięty przez Huanga "zabójczą aplikacją" świata komputerów. Układ ten charakteryzuje się niezwykłą wydajnością, jest dziesięciokrotnie szybszy, znacznie tańszy i ma niższe zapotrzebowanie na energię.

Huang podkreślił demokratyzujący wpływ sztucznej inteligencji, podkreślając, że technologia ta jest dostępna dla każdego. Podczas wydarzenia zaprezentowano również inne ekscytujące rozwiązania. Jedną z takich atrakcji jest doświadczenie Dreamscape free-roam, "Clockwork Forest", pochodzące z laboratoriów w Genewie. Ta innowacja stanowi znaczącą zmianę w technologii, odchodząc od plecaków PC. Jest to wynik szeroko zakrojonych badań i rozwoju prowadzonych przez Vicon i Artanim, szwajcarski instytut badawczy stojący za platformą technologiczną VR Dreamscape.

Chociaż technologia ta jest wciąż w fazie prototypu i nie jest jeszcze dostępna na rynku, ma ogromny potencjał w różnych zastosowaniach, w tym w hollywoodzkim VFX, grach AAA oraz naukach przyrodniczych i inżynierii. Doświadczenie Dreamscape będzie otwarte dla publiczności w lokalizacji LA od początku sierpnia.

Siggraph świętował również 50. rocznicę powstania dzięki Tunelowi Czasu, wciągającej wystawie ilustrującej przełomowe wydarzenia w branży grafiki komputerowej. Stworzona przez ACM, Autodesk i zespół studentów z Uniwersytetu Kalifornijskiego w Santa Barbara, wystawa ta zapewnia wciągające spojrzenie na ewolucję branży.

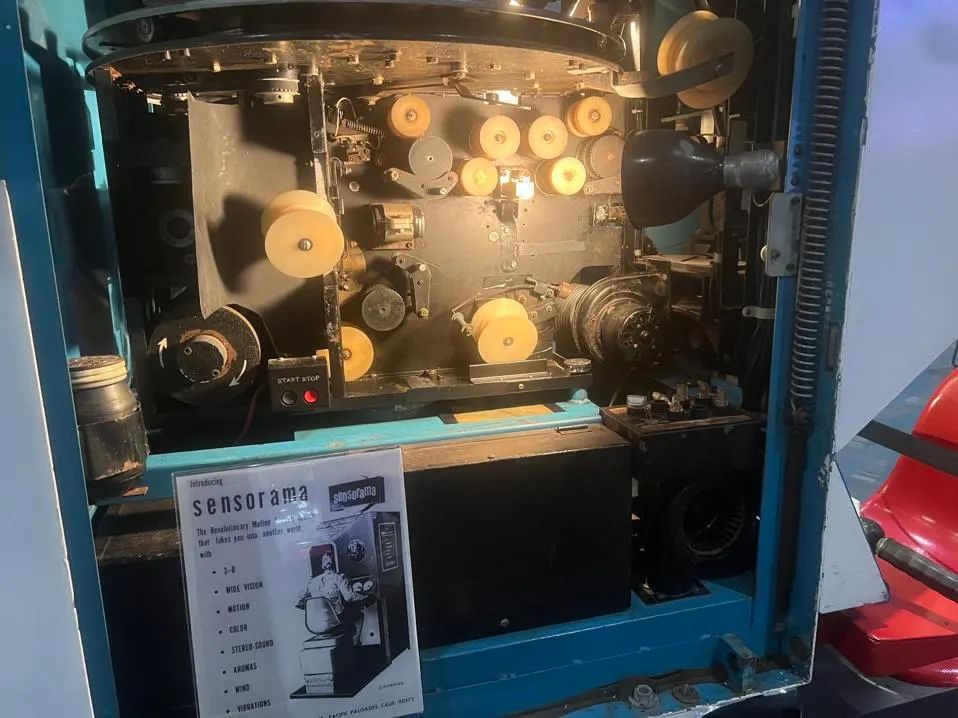

Innym fascynującym dziełem na wystawie była Sensorama Morta Heiliga, mechaniczne cudo. Scott Fisher z USC wspomniał o trwających pracach konserwatorskich, mających na celu przywrócenie do życia kadłuba z włókna szklanego i drewna, który zawiera projektor filmowy i aparat węchowo-wizyjny. Filmy stworzone przez Heiliga prezentowały hipnotyzującą, ręczną przygodę z piękną dziewczyną na wybrzeżu Kalifornii i ekscytującą jazdę motocyklem z prędkością 60 mil na godzinę przez Nowy Jork w 1956 roku. Heilig pierwotnie wycenił wciągające kino na 6 000 USD (równowartość 67 000 USD dzisiaj), wymagając 24 000 odtworzeń po 25 USD za sztukę, aby osiągnąć próg rentowności. Jednak niepraktyczność projektu Sensoramy sprawia, że jest to pomysł wyprzedzający swoje czasy.

Wydarzenie obejmowało również słynne demo Ivana Sutherlanda z 1968 roku, które odtworzyło jego laboratorium i pierwsze doświadczenia VR. Ten historyczny moment został przywrócony do życia w VR na Quest, zapewniając krótkie, ale intrygujące spojrzenie na wczesne dni wirtualnej rzeczywistości.

Sesje Frontiers rozpoczną dzisiejszy harmonogram o 8 rano, obiecując zdumiewające spostrzeżenia i przełomowe odkrycia!

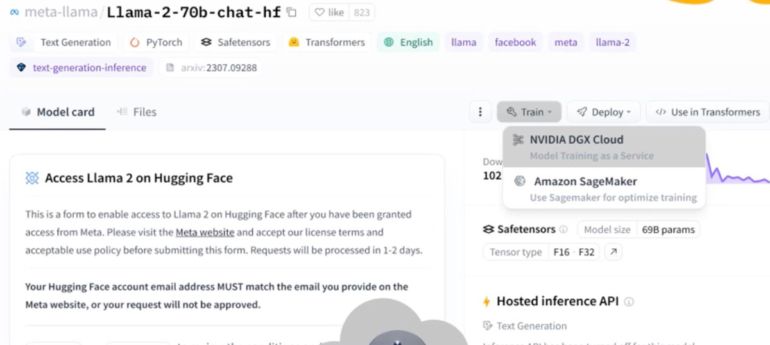

Na czele priorytetów firmy NVIDIA podczas konferencji grafiki komputerowej SIGGRAPH, która odbyła się 8 sierpnia, znalazła się sfera generatywnej sztucznej intelig encji. Kluczowe ogłoszenia w sektorach korporacyjnym i przemysłowym obracały się wokół trójki postępów: usługi Hugging Face Training Service, napędzanej potęgą NVIDIA DGX Cloud; najnowocześniejszej iteracji NVIDIA AI Enterprise (wersja 4.0); oraz odsłonięcia zestawu narzędzi AI Workbench, które mają na celu przedefiniowanie krajobrazu wdrożeń generatywnej sztucznej inteligencji.

Ujawnienie "Superchip" z procesorem HBM3e dla zaawansowanego rozwoju sztucznej inteligencji

NVIDIA wykorzystała ten moment, aby zaprezentować GH200, nadchodzący dodatek do serii platform Grace Hopper. Oparta na innowacyjnym "superchipie" Grace Hopper, ta iteracja, oznaczona jako GH200, składa się z pojedynczego serwera wyposażonego w 144 rdzenie Arm Neoverse, szczycącego się oszałamiającą mocą obliczeniową ośmiu petaflopów i 282 GB pamięci, z których wszystkie działają w standardzie HBM3e. Standard ten wprowadza niezwykłą przepustowość 10 TB/s, imponującą trzykrotną poprawę w stosunku do swojego poprzednika, HBM3.

Jensen Huang, wizjonerski założyciel i dyrektor generalny firmy NVIDIA, podkreślił: "Aby zaspokoić rosnące zapotrzebowanie na generatywną sztuczną inteligencję, centra danych wymagają akcelerowanych platform obliczeniowych o wyspecjalizowanych możliwościach. Nowa platforma GH200 Grace Hopper Superchip zapewnia właśnie to dzięki niezrównanej technologii pamięci, optymalizacji przepustowości w celu zwiększenia przepustowości, możliwości łączenia układów GPU w celu zwiększenia połączonej wydajności oraz architekturze serwerowej zaprojektowanej z myślą o łatwym wdrażaniu w całym centrum danych".

Supremacja AI w chmurze DGX, teraz dostępna przez Hugging Face

Uznana superkomputerowa moc obliczeniowa DGX Cloud AI firmyNVIDIA wchodzi na nową ścieżkę dzięki połączeniu sił z Hugging Face, kluczowym graczem w dziedzinie generatywnej sztucznej inteligencji. Sojusz ten ułatwia osobom, które chcą trenować i dostrajać generatywne modele sztucznej inteligencji, dostępne na rynku Hugging Face. Organizacje, które potrzebują niestandardowych rozwiązań generatywnej sztucznej inteligencji, często są zmuszone do trenowania modeli na zastrzeżonych danych, co jest procesem wymagającym znacznej przepustowości.

Manuvir Das, wiceprezes działu Enterprise Computing w firmie NVIDIA, podkreślił harmonijną współpracę, stwierdzając: "Synergia między Hugging Face i NVIDIA jest wrodzona, ponieważ Hugging Face jest ostatecznym repozytorium do wstępnej eksploracji, podczas gdy NVIDIA DGX Cloud zapewnia idealną arenę do angażowania się w generatywną sztuczną inteligencję wykorzystującą te modele". Oferta DGX Cloud obejmuje NVIDIA Networking, wysokowydajną sieć o niskich opóźnieniach, a także osiem procesorów graficznych NVIDIA H100 lub A100 80 GB Tensor Core na każdym węźle, łącznie zapewniających 640 GB pamięci GPU.

Szkolenie DGX Cloud AI będzie wiązało się z dodatkowymi opłatami w ramach Hugging Face, aczkolwiek dokładne szczegóły dotyczące cen pozostają nieujawnione. Ta wspólna inicjatywa ma zostać uruchomiona w nadchodzących miesiącach. Clément Delangue, współzałożyciel i dyrektor generalny Hugging Face, pochwalił potencjał partnerstwa, zapewniając: "Globalna społeczność tworzy nowe połączenia i odkrycia dzięki generatywnym narzędziom sztucznej inteligencji, a my dopiero zarysowujemy powierzchnię tej rewolucji technologicznej. Nasz sojusz wprowadzi czołowe superkomputery AI firmy NVIDIA do Hugging Face, umożliwiając przedsiębiorstwom przejęcie kontroli nad ich przeznaczeniem AI za pośrednictwem zasobów open-source".

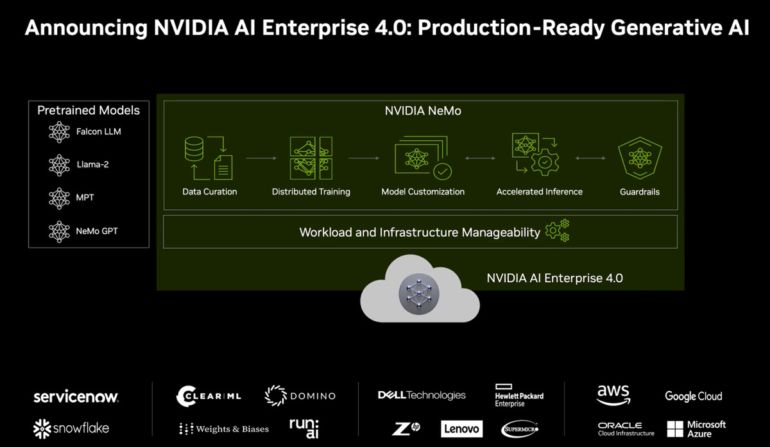

AI Enterprise 4.0: Spojrzenie w przyszłość

Nadchodząca iteracja NVIDIA AI Enterprise, kompleksowego pakietu obejmującego oprogramowanie do sztucznej inteligencji i analizy danych dostosowane do tworzenia generatywnych rozwiązań AI, ma przejść do wersji 4.0. Cechą charakterystyczną tej iteracji jest włączenie NeMo, instrumentalnej platformy do tworzenia narzędzi na zamówienie w zakresie generatywnej sztucznej inteligencji, dostosowywania szkoleń, wnioskowania, ustanawiania zabezpieczeń i nie tylko. NeMo wprowadza natywną dla chmury strukturę, zaprojektowaną w celu ułatwienia tworzenia i wdrażania aplikacji korporacyjnych opartych na rozbudowanych modelach językowych.

Renomowani dostawcy uczenia maszynowego, w tym ClearML, Domino Data Lab, Run:AI i Weights & Biases, współpracowali z firmą NVIDIA , aby płynnie zintegrować swoje usługi z AI Enterprise 4.0, zapewniając synergiczne wrażenia.

AI Workbench: Podniesienie poziomu generatywnego przepływu pracy AI

AI Enterprise 4.0 nawiązuje współpracę z NVIDIA AI Workbench, dedykowaną przestrzenią roboczą zaprojektowaną w celu usprawnienia i uproszczenia procesu uruchamiania aplikacji AI na komputerach osobistych lub domowych stacjach roboczych. AI Workbench umożliwia projektom płynne przechodzenie przez różne domeny, takie jak komputery PC, centra danych, chmury publiczne i własna infrastruktura NVIDIA DGX Cloud.

Jak stwierdził Manuvir Das,"A I Workbench oferuje systematyczne podejście do hermetyzacji inicjatyw AI, umożliwiając płynną migrację w różnych środowiskach". Deweloperzy mogą konsolidować swoje modele, frameworki, zestawy SDK i biblioteki z repozytoriów open-source i platformy NVIDIA AI w ujednoliconej domenie. Następnie mogą inicjować, oceniać i udoskonalać generatywne produkty AI na komputerze RTX lub stacji roboczej, a w razie potrzeby bez wysiłku skalować je do centrum danych i zasobów obliczeniowych w chmurze.

Joey Zwicker, wiceprezes ds. strategii AI w HPE, pochwalił potencjał NVIDIA AI Workbench, podkreślając jego zdolność do usprawnienia rozwoju projektów generatywnej sztucznej inteligencji, od powstania do szkolenia i wdrożenia jednym kliknięciem.

AI Workbench ma zostać wydany jesienią 2023 roku i będzie oferowany bez dodatkowych kosztów w ramach innych subskrypcji produktów, w tym AI Enterprise.

Wzmocnienie pozycji przedsiębiorstw dzięki nowym stacjom roboczym RTX i procesorom graficznym do generatywnej sztucznej inteligencji

Na froncie sprzętowym NVIDIA zaprezentowała nową linię stacji roboczych RTX, wzmocnionych procesorami graficznymi RTX 6000 i wyposażonych w obsługę sztucznej inteligencji klasy korporacyjnej. Te stacje robocze zostały skrupulatnie zaprojektowane, aby sprostać ogromnym wymaganiom GPU związanym z digitalizacją przemysłową i wizualizacją 3D w przedsiębiorstwach.

Rodzina procesorów graficznych dla stacji roboczych Ada wita swoich najnowszych członków: RTX 5000, RTX 4500 i RTX 4000. RTX 5000 jest obecnie dostępny, podczas gdy RTX 4500 i RTX 4000 mają zostać wydane odpowiednio w październiku i wrześniu 2023 roku.

Równolegle NVIDIA zaprezentowała innowacyjną architekturę serwerów OVX, z których każdy może pomieścić do ośmiu procesorów graficznych L40S Ada. Serwery te płynnie integrują się z oprogramowaniem AI Enterprise, stanowiąc atrakcyjną propozycję do tworzenia treści, w tym obrazów generowanych przez sztuczną inteligencję dla dziedzin takich jak projektowanie graficzne, animacja i architektura.

Dan Stine, dyrektor ds. technologii projektowania w firmie architektonicznej Lake|Flato, potwierdził sprawność procesorów graficznych RTX 5000, zwracając uwagę na ich znaczny wzrost wydajności i rozbudowany bufor klatek, co przekłada się na doskonałe wrażenia w rzeczywistości wirtualnej, które zapewniają klientom kontekstowe i wciągające spotkanie.

Innowacje dzięki Omniverse i OpenUSD dla cyfrowej współpracy bliźniaczej

Omniverse firmy NVIDIA, platforma rozwojowa, która służy jako węzeł do tworzenia i obsługi aplikacji do cyfryzacji przemysłowej w połączeniu ze standardem wizualizacji 3D, OpenUSD, jest gotowa na znaczące aktualizacje. Platforma ta jest przeznaczona dla szerokiego spektrum dziedzin, od animacji 3D i tworzenia gier po produkcję motoryzacyjną. Kilka aktualizacji jest bezpośrednio związanych z niedawną współpracą firmy NVIDIA z Universal Scene Description, formatem open-source o kluczowym znaczeniu dla tworzenia obiektów i elementów w dziedzinie grafiki 3D.

Rev Lebaredian, wiceprezes działu Omniverse and Simulation Technology w firmie NVIDIA, podsumował istotę tej ewolucji: "Podmioty przemysłowe dążą do zrewolucjonizowania swoich przepływów pracy poprzez cyfryzację, wprowadzając zwiększone zapotrzebowanie na wzajemnie połączone, interoperacyjne ekosystemy oprogramowania 3D".

Najnowsza wersja Omniverse, znajdująca się obecnie w fazie beta, prezentuje szereg integracji wykorzystujących USD. Wśród nich na uwagę zasługuje partnerstwo z aplikacją Adobe do generowania obrazów AI, Firefly.

Znane firmy, takie jak Boston Dynamics, wykorzystały Omniverse do projektowania przemysłowego, wykorzystując go do symulacji robotyki i systemów sterowania, podkreślając w ten sposób jego różnorodne zastosowania.

Podsumowując, konferencja SIGGRAPH 2023 posłużyła firmie NVIDIA jako scena do zaprezentowania konstelacji transformacyjnych postępów w zakresie platform generatywnej sztucznej inteligencji, cyfryzacji przemysłowej, procesorów graficznych i nie tylko. Dzięki innowacjom obejmującym od superchipa GH200 Grace Hopper po potencjał współpracy między Hugging Face i DGX Cloud, a także od ewolucji AI Enterprise po wprowadzenie AI Workbench, NVIDIA umacnia swoją rolę awangardy w napędzaniu świata sztucznej inteligencji. W połączeniu z premierą nowych stacji roboczych i procesorów graficznych RTX, a także ożywieniem Omniverse poprzez integrację OpenUSD, oznacza to kluczowy punkt zwrotny w dziedzinie sztucznej inteligencji i technologii przemysłowych. W miarę jak te przełomowe odkrycia nadal przekształcają branże i torują drogę dla przyszłych postępów, krajobraz możliwości w świecie sztucznej inteligencji staje się bardziej ekscytujący niż kiedykolwiek wcześniej.

Nasz pierwszy Keynote rozpocznie się o 9 rano! Darío Gil, starszy wiceprezes i dyrektor IBM Research, opowie o tym, co będzie dalej w obliczeniach kwantowych w West Hall B.

Przygotuj się na poznanie najnowocześniejszego świata akceleracji obliczeń na GPU w chmurze na potrzeby uczenia maszynowego, renderowania efektów wizualnych, analizy dużych zbiorów danych i obliczeń kognitywnych, gdy GenesisCloud wejdzie na scenę SIGGRAPH 2023. Świętując 50. rocznicę konferencji, GenesisCloud z przyjemnością zaprezentuje swoją wiedzę jako wybitny dostawca chmury obliczeniowej dla akceleratorów.

Pamiętaj, aby zaznaczyć swoje kalendarze i odwiedzić stoisko numer 1129, gdzie zespół Genesis Cloud z niecierpliwością czeka, aby przedstawić Ci swoje przełomowe rozwiązania w chmurze obliczeniowej, które rewolucjonizują krajobraz VFX i renderowania z niezrównaną wydajnością, przystępną ceną i zrównoważonym rozwojem.

Genesis Cloud: Europejski pionier infrastruktury chmurowej

Jako wiodący europejski dostawca infrastruktury chmurowej, Genesis Cloud specjalizuje się w różnych obciążeniach, w tym w uczeniu maszynowym, renderowaniu, Blockchain, transkodowaniu i bezpieczeństwie IT. Dzięki silnemu zaangażowaniu w odpowiedzialność za środowisko, firma oferuje w 100% ekologiczną moc obliczeniową, zapewniając niezwykły stosunek wydajności do kosztów dla każdego obciążenia. Wykorzystaj moc zoptymalizowanych pod kątem kosztów układów GPU, umożliwiając elastyczne uruchamianie obciążeń na żądanie lub w trybie always-on, co przekłada się na znaczne oszczędności kosztów w porównaniu z wdrożeniami lokalnymi.

Uwolnienie pełnego potencjału układów GPU

Genesis Cloud wykorzystuje karty klasy konsumenckiej firmy Nvidia w niezawodnym, wysokowydajnym środowisku wspieranym przez centra danych i infrastrukturę serwerową klasy korporacyjnej. Firma pozostaje w czołówce innowacji, wprowadzając karty klasy komercyjnej i akceleratory inne niż GPU, dostosowane do konkretnych potrzeb, takich jak LLM i generatywna sztuczna inteligencja. W szczególności współpraca z Habana Labs, firmą Intel, doprowadziła do opracowania procesora Gaudi2, poszerzając horyzonty możliwości dla użytkowników Genesis Cloud.

Świadectwo Miguela Espady

Dzięki entuzjastycznym opiniom zadowolonych klientów jest oczywiste, że Genesis Cloud spełnia swoje obietnice. Miguel Espada, CEO i współzałożyciel Espadaysantacruz Studio oraz współzałożyciel SpecialGuestX, dzieli się swoimi doświadczeniami z pracy z Genesis Cloud przy projekcie "Carvana Joyrides". Projekt obejmował stworzenie unikalnych filmów dla każdego z miliona sprzedanych samochodów Carvana przy użyciu sztucznej inteligencji i renderowania w chmurze. Dzięki elastyczności i skalowalności Genesis Cloud, wygenerowali oni zdumiewające 1 345 948 spersonalizowanych filmów, w sumie około 45 000 godzin treści. To osiągnięcie pokazuje prawdziwy potencjał renderowania w chmurze z Genesis Cloud.

Wspieranie kreatywności dzięki przejrzystym cenom

Mając do dyspozycji karty Nvidia, użytkownicy Genesis Cloud mogą cieszyć się płynnym i przyjaznym dla użytkownika środowiskiem opartym na chmurze. Uczciwe i przejrzyste ceny firmy, zaczynające się od zaledwie 0,20 USD za godzinę za dedykowany procesor graficzny na żądanie, wraz z zerowymi opłatami za wejście/wyjście danych, sprawiają, że jest to atrakcyjna opcja zarówno do użytku osobistego, jak i biznesowego. Funkcja organizacyjna pomaga również zespołom w łatwej współpracy nad wieloma projektami.

Połącz się z Genesis Cloud na SIGGRAPH

Genesis Cloud jest niezmiernie dumny z bycia aktywnym członkiem społeczności, a SIGGRAPH był ich pierwszą wystawą w 2018 roku, we współpracy z AMD. Teraz, w ramach obchodów 50-lecia SIGGRAPH, zespół Genesis Cloud z niecierpliwością czeka na spotkanie z innymi entuzjastami, ekspertami i wizjonerami w West Hall w Los Angeles Conference Center na stoisku 1129.

Nie przegap tej złotej okazji, aby uwolnić prawdziwy potencjał swojej kreatywnej wizji. Odwiedź stoisko Genesis Cloud, aby dowiedzieć się, w jaki sposób ich wysokowydajne i ekonomiczne rozwiązania mogą wynieść Twoje projekty na nowy poziom. Dzięki szybkiemu procesowi rejestracji i darmowym kredytom, możesz uruchomić nowe instancje w zaledwie dwie minuty i doświadczyć przyszłości obliczeń GPU w chmurze z pierwszej ręki. Dołącz do rewolucji Genesis Cloud już dziś!

Zanurz się w oszałamiających narracjach VR i zapierających dech w piersiach wrażeniach wizualnych, które przesuwają granice opowiadania historii i technologii w naszych kioskach VR Theater SIGGRAPH 2023 w Los Angeles. Masz również okazję spotkać genialne umysły stojące za tymi przełomowymi doświadczeniami VR! Nie przegap tej niezwykłej okazji, aby zobaczyć przyszłość kina i wejść w interakcję z utalentowanymi umysłami stojącymi za tym wszystkim.

https://s2023.siggraph.org/full-program/?filter1=sstype153&fbclid=IwAR1aVKz8wfz_D1dH9JIXAspi9kzmSECgo01BRoB8tUY5A0AiVnfc19YpAqM

Komentarze